Stable Diffusion

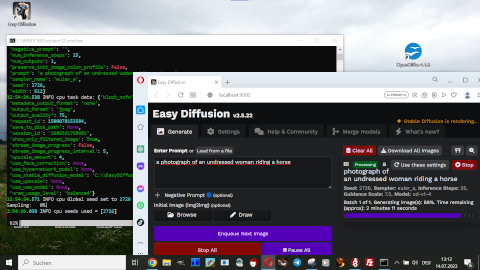

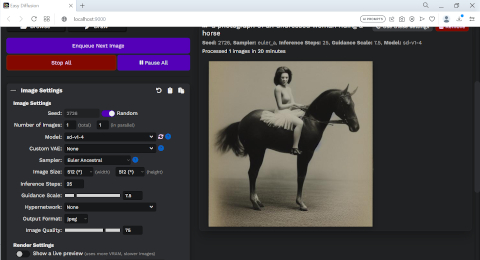

Ich habe mir mal Stable Diffusion auf meinen ältesten und „schlechtesten“ Rechner geladen, den ich nur im Büro und auf Reisen benutze (weil er klein ist): Intel(R) Core(TM) i3-7020U CPU @ 2.30GHz 2.30 GHz mit 8 GB RAM. Der braucht für ein Bild mehr als eine Viertelstunde, und natürlich ist es nicht so gut wie von Midjourney gemacht. Ich wollte es nur ausprobieren und habe keinen anspruchsvollen Prompt benutzt. Mal sehen, was mein Gamer-PC mit Linux dazu sagt…

Kommentare

6 Kommentare zu “Stable Diffusion”

Schreibe einen Kommentar

-

-

Last posting:

-

-

Themen

- About this Blog

- Ajax vom Teufelslauch

- Ancestry

- Babylonien

- Das Ministerium für Wahrheit informiert

- Deutsch des Grauens

- Die Online-Durchsuchung

- Die Rote Fahne

- Economy

- Feuilleton

- Gleisdreieck

- GPF

- Grenada

- Hausmitteilung

- Heimat

- Internet and Computer

- Israel

- KI

- Lateinamerika

- Lautsprecher des Kapitals

- Leser fragen Burks

- Lifestyle

- Links I Like

- Media

- Meine Artikel

- Meine Bücher

- MoPo

- Panorama

- Polen

- Politics

- Privacy

- Schach

- Science

- Second Life

- Security

- Sprengchemie

- Tweet of the day

- USA

- Vereinsmeierei

- Zitate, die man sich merken sollte

-

Archiv

- Juli 2024

- Juni 2024

- Mai 2024

- April 2024

- März 2024

- Februar 2024

- Januar 2024

- Dezember 2023

- November 2023

- Oktober 2023

- September 2023

- August 2023

- Juli 2023

- Juni 2023

- Mai 2023

- April 2023

- März 2023

- Februar 2023

- Januar 2023

- Dezember 2022

- November 2022

- Oktober 2022

- September 2022

- August 2022

- Juli 2022

- Juni 2022

- Mai 2022

- April 2022

- März 2022

- Februar 2022

- Januar 2022

- Dezember 2021

- November 2021

- Oktober 2021

- September 2021

- August 2021

- Juli 2021

- Juni 2021

- Mai 2021

- April 2021

- März 2021

- Februar 2021

- Januar 2021

- Dezember 2020

- November 2020

- Oktober 2020

- September 2020

- August 2020

- Juli 2020

- Juni 2020

- Mai 2020

- April 2020

- März 2020

- Februar 2020

- Januar 2020

- Dezember 2019

- November 2019

- Oktober 2019

- September 2019

- August 2019

- Juli 2019

- Juni 2019

- Mai 2019

- April 2019

- März 2019

- Februar 2019

- Januar 2019

- Dezember 2018

- November 2018

- Oktober 2018

- September 2018

- August 2018

- Juli 2018

- Juni 2018

- Mai 2018

- April 2018

- März 2018

- Februar 2018

- Januar 2018

- Dezember 2017

- November 2017

- Oktober 2017

- September 2017

- August 2017

- Juli 2017

- Juni 2017

- Mai 2017

- April 2017

- März 2017

- Februar 2017

- Januar 2017

- Dezember 2016

- November 2016

- Oktober 2016

- September 2016

- August 2016

- Juli 2016

- Juni 2016

- Mai 2016

- April 2016

- März 2016

- Februar 2016

- Januar 2016

- Dezember 2015

- November 2015

- Oktober 2015

- September 2015

- August 2015

- Juli 2015

- Juni 2015

- Mai 2015

- April 2015

- März 2015

- Februar 2015

- Januar 2015

- Dezember 2014

- November 2014

- Oktober 2014

- September 2014

- August 2014

- Juli 2014

- Juni 2014

- Mai 2014

- April 2014

- März 2014

- Februar 2014

- Januar 2014

- Dezember 2013

- November 2013

- Oktober 2013

- September 2013

- August 2013

- Juli 2013

- Juni 2013

- Mai 2013

- April 2013

- März 2013

- Februar 2013

- Januar 2013

- Dezember 2012

- November 2012

- Oktober 2012

- September 2012

- August 2012

- Juli 2012

- Juni 2012

- Mai 2012

- April 2012

- März 2012

- Februar 2012

- Januar 2012

- Dezember 2011

- November 2011

- Oktober 2011

- September 2011

- August 2011

- Juli 2011

- Juni 2011

- Mai 2011

- April 2011

- März 2011

- Februar 2011

- Januar 2011

- Dezember 2010

- November 2010

- Oktober 2010

- September 2010

- August 2010

- Juli 2010

- Juni 2010

- Mai 2010

- April 2010

- März 2010

- Februar 2010

- Januar 2010

- Dezember 2009

- November 2009

- Oktober 2009

- September 2009

- August 2009

- Juli 2009

- Juni 2009

- Mai 2009

- April 2009

- März 2009

- Februar 2009

- Januar 2009

- Dezember 2008

- November 2008

- Oktober 2008

- September 2008

- August 2008

- Juli 2008

- Juni 2008

- Mai 2008

- April 2008

- März 2008

- Februar 2008

- Januar 2008

- Dezember 2007

-

Archiv spiggel.de

-

Intern

-

Burks' Bücher (Auswahl)

-

-

-

About Burks

Spenden für burks.de via Paypal

-

Werkzeuge

Journalistische Recherche | Werkzeuge

Journalistische Recherche | Wirtschaft

Discord/Midjourney MidJourney Prompt Helper ChatGPT OpenAI Playground DALL-E Stable Diffusion Stable Diffusion Prompt Builder Bard Ancestry -

I like:

Achgut GMB Akash (Bangladesh) Elder of Ziyon Fefes Blog Linguistik vs. Gendern Living in a Modemworld Neulandrebellen Michael Roberts Blog OpenAI PinkKosherNostra SciLogs Der Schockwellenreiter The Far Side unbesorgt.de (Roger Letsch) -

International

Al Jazeera (Katar) Beijing Rundschau (VR China) Caracas Chronicles (Venezuela) China Daily (VR China) China Labour Bulletin (Hongkong, VR China) CNN (USA) Clarín (Argentinien) Dagens Nyheter (Schweden) Daily Beast (USA) Daily Kos (USA) El Blog de Abel (Argentinien) El Diario (Bolivien) El Dinamo (Chile) El Espectador (Kolumbien) enlazeZapatista (Mexiko) Foreign Policy (USA) Global Times (VR China) Granma (Kuba) The Guardian (UK) The Hindu Indian Punchline (M.K. Bhadrakumar, Indien) Infosperber (Schweiz) Israel Hayom (Israel, engl.) Israelnetz (Israel, engl.) The Japan Times (Japan) Jerusalem Post (Israel) Jyllands Posten (Dänemark) La República Perú Le Monde (Frankreich) Libération (Frankreich) Marginal Revolution (USA) Mediapart (fr., engl., es.) Mother Jones (USA) naked capitalism (USA) New York Times (USA) Nikkei Asia (Japan) Perúvian Times (Perú) Portal america21.de Pravda (Ukraine) Publico (Portugal) Rickard Falkvinge (Schweden) The Rio Times (Brasilien) RT.DE (Russland) Shanghai Daily (VR China) South China Morning Post (Hongkong) The Diplomat (USA, Asia-Pacific region) The Times of India The Warsaw Voice (Polen) Washington Post (USA) Xinhua (VR China) -

Lifestyle & Leibesübungen:

Katha kocht Sportschule Choi -

Journalism | Science | Privacy | Computer

-

Neukölln

Facetten Neukoellner 48 Stunden Neukölln

;-)… nur mit schnell wirkenden Substanzen rezipierbar, möchte ich hier und überhaupt JEVERkünden.

ab 0:56:

https://cdn.spielfilm.de/trailer/6447/9646_30332.mp4

Sorry – hier der funktionierende Link zum Trailer

ab 0:56:

https://www.youtube.com/watch?v=cX53cl8T3qk

Fang mal mit nem ZX81 an und dann über C64 ff hochskalieren.

Es tun sich wunderbare Welten auf.

Neuerdings tun sie so, als ob das Entpacken durch ne fette GPU und direktes Schreiben von Daten ins RAM der neueste Brüller wäre (https://www.heise.de/news/Ratchet-Clank-Vorzeigespiel-fuer-PS5-SSD-benoetigt-auf-PC-nur-eine-Festplatte-9216432.html).

Aufs BS kommt es nicht an, die Hardware muss passen.

Ob sich wohl rendern lässt, wie das aussieht, wenn eine zu dicke Frau einfach platzt? Müssen ja keine großen schwarzen Flecken auf dem Rock sein …

Drei Bemerkungen:

CPU und RAM tragen recht wenig zu Laufzeit bei, GPU-RAM ist die relevanteste Komponente (aber „Gamer-PC“ klingt so als könnte das dort eher passen).

„natürlich ist es nicht so gut wie von Midjourney“ ist m.E. eine falsche Erwartungshaltung. SD Ergebnisse können sehr vergleichbar oder gar besser sein, wenn man die passenden Basis-Modelle und/oder Extensions (LORAs etc.) verwendet. Technisch gesehen kann man die SD Modelle mit Midjourney Output trainieren und dann sieht der Output dann auch eben entsprechend aus. (Wurde schon gemacht.) Bringt einen aber nicht wirklich weiter. („Können wir auch!“ – „Na und? Ich wechsele höchstens, wenn ihr spürbar _mehr_ könnt.“)

Einfach mal die Bilder auf Seiten wie Civitai vergleichen (den Hentai Krams muss man halt ebenso wie die NSFW Abteilung überblättern, um eher so etwas wie Qualität zu sehen).

Erstmal hat immer der die Nase vorne, der die meisten User findet, die kostenfrei das eigene Produkt verbessern. Das ist global immer noch MJ, aber da die m.W. extrem limitieren, _was_ User beitragen können, hat diesbezüglich SD massive Vorteile. Mal sehen, auf welchem Wege die kapitalgetriebene Seite die Open Source Konkurrenz diesmal wegbeissen wird.

Mal vllig losgelöst von der Leistungsdiskussion (deiner Rechner), probier lieber das hier:

https://github.com/AUTOMATIC1111/stable-diffusion-webui

M.M. nach viel leichter in der Bedienung und v.a. eine riesige Modellauswahl via Civit.ai…..

Das hat – zumindest bei mir – den Einstieg sehr erleichtert.